麻省理工学院(MIT)计算机科学暨人工智能实验室(CSAIL)及专精于机器学习的新创公司PatternEx近日共同发表一份研究报告,展示了一个新的人工智能系统AI2(原意为AI的平方,下面均以AI2表示),其预测网络攻击行动的准确度高达85%,为先前系统的3倍。

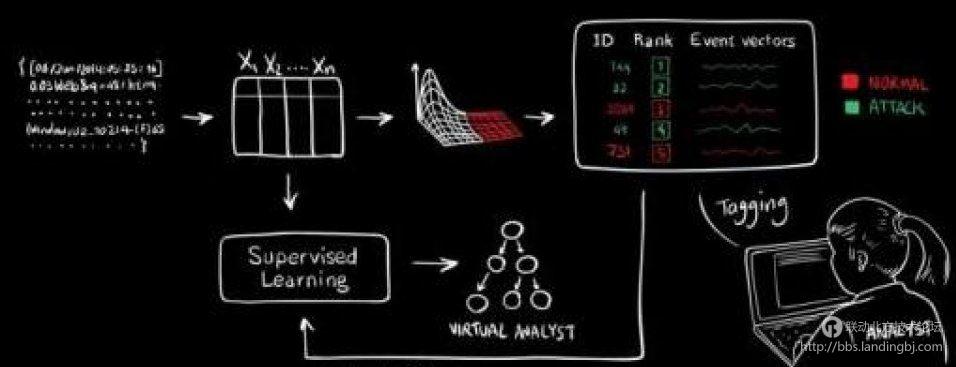

AI2使用非监督式机器学习(unsupervised machine-learning)将资料转化成有意义的模式,以用来检查可疑的事件,之后将这些事件交由人类分析师来判断哪些事件属于真正的攻击,再将成果反馈到系统上。

CSAIL科学家Kalyan Veeramachaneni表示,大家可将AI2视作一个虚拟分析师,它可以持续地产生新的模式,而且能在数小时内进行调整,代表它能够快速且明显地改善侦测率。

要建立一个结合人脑与计算机的网络安全系统并不容易,部份原因来自于必须手动标注网络安全资料的算法。举例来说,要发展可高度辨识物件的计算机视觉算法时,只需几个寻常志工来标注物件或非物件照片,然后送进算法即可,但在一个攸关网络安全的系统上,多数人并不具备可标注诸如DDOS或渗出攻击(exfiltration attacks)的能力,必须仰赖安全专家的协助。

然而,专家们通常是忙碌的,也不太可能花一整天的时间来辨识这些可疑的事件,因此一个有效率的机器学习系统必须能够在不耗尽人力的情况下自我改善。

AI2在第一天的训练中取出了200个可疑事件,交由安全专家进行判断,随着安全专家日复一日将成果反馈至算法中,不多久每天需要安全专家辨识的可疑事件就可下滑至30到40个。在扫描36亿行的日志及经过3个月的训练之后,AI2系统侦测攻击行动的准确率便已达到85%。

该团队指出,AI2每天所扫描的日志可拓展至数十亿行,将众多的资料转换成各种不同的行为类别,再借以判断是正常或异常。

该贴由hui.chen转至本版2017-4-14 9:57:45

技术讨论

技术讨论